2. 中兴通讯股份有限公司南京研发中心,南京 210000

2. Nanjing Research and Development Center of ZTE Corporation, Nanjing 210000, China

三维视觉测量技术指的是测量物体表面各点的三维分布,计算各点的深度和轮廓信息的点云数据,最后通过平面拟合来重构物体表面的三维轮廓信息[1].随着科技进步,三维测量技术在精度和速度方面都有了很大程度的提高,在工业自动化、汽车飞机制造、医学等领域具有广阔的应用前景[2].光学三维测量方法主要分被动式三维测量和主动式三维测量两种,前者测量设备本身不发出信号,通过被测物体辐射信号或者光反射回来的信号来实现测量,具有结构简单、成本低、受测量环境影响小等优点,但是测量精度低[3].而后者,测量系统主动将光信号投射到被测物体上,接收从物体表面反射回来的光信号,经过一系列的解码来完成测量,具有测量精度高,测量范围大等优点,不过测量设备复杂,受测量环境影响较大,存在gamma畸变[4].

典型的gamma畸变矫正方法有gamma值预编码法、投影仪散焦法、相位迭代法、排除误差法、双三步相移法、高次谐波消除法等[5],其中,gamma值预编码法[6]和投影仪散焦法[7]过程复杂,精度提高有限,相位迭代法的收敛条件有待解决[8],而排除误差法受实时性制约.本文为进一步提高光结构三维测量的精度,减小算法的计算量,提出了一种基于相位偏移的gamma误差补偿与矫正算法,该算法通过引入初始相位偏移,对相位角进行补偿,采取四步相移法求取包裹相位的平均值,来消除由测量设备的非线性所引起的gamma误差,并对矫正前后的三维重构点云图进行了对比分析.

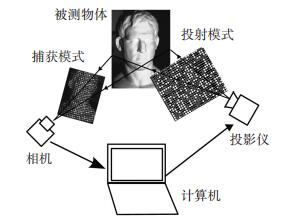

1 结构光三维测量技术结构光法指的是使用投影仪等投射设备把光点、光栅或网格等已知的光模式投射到被测量的物体表面,然后被测量的物体会对这些图像进行调制,再用摄像机等装置捕获经被测物体的表面调制的图像,然后对这些图像进行解码操作,就可以把被测量物体的深度信息根据三角原理给求取出来.结构光测量系统一般由图像投射装置、图像捕获装置(如摄像机)、图像处理装置(如计算机)等组成,图 1为结构光测量系统示意图[9].

|

图 1 结构光法测量系统示意图 Figure 1 Schematic diagram of structured light measurement system |

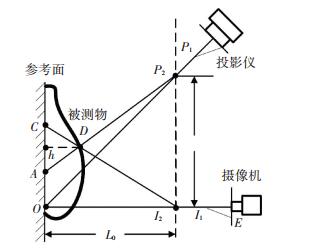

基于三角形原理的结构光法测量系统如图 2所示.其中,投影仪分别在P1和P2进行光线的入射和出射,而摄像机分别在I1和I2进行光线的入射和出射.由测量原理图可知,假设摄像机的成像光轴是垂直于参考面的,而投影仪的投射光轴和摄像机的捕获光轴在参考平面上的O点相交,则参考平面上各个点的相位值相对于点O是唯一的,而且是保持单调的[10].

|

图 2 基于三角形原理的结构光法测量系统 Figure 2 The measurement system of structured light method based on a triangular algorithm |

首先用投影仪将已知光模式投射到标准平板上,然后用摄像机捕获图像,再对图像进行相位展开,求取平板上各像素点的绝对相位值.对于参考面上的一点A,在相机捕获的图像中该点的相位值为φA;对于参考面上的一点C,在相机捕获的图像中与C点相对应的点为E,且该点的相位值为φC.然后,将被测量的物体放置到参考平面前面,则摄像机捕获的图像中的E点在这里对应的是被测量的物体表面的D点,此时E点的相位值就是φD.根据已经知道的点C、点O和点A的坐标位置可以把两个像素点之间的距离OC和OA给求取出来,从而进行计算能够求出AC.然后,利用三角形的相似原理,则点D的深度H的计算公式为

| $ h = \frac{{\overline {AC} \left( {{L_0}/d} \right)}}{{1 + \overline {AC} /d}}. $ | (1) |

式中:h为被测量的物体表面D点相对于参考平面的高度,L0和d为该测量系统的参数.

相机从被测量的物体表面捕获的点E的对应相位为φD,而相机从参考平面上捕获的点E的对应相位为φC,由此可以把该像素点在被测量的物体放置前后的相位差值Δφ(x, y)给求取出来,然后就可以把被测量的物体在该像素点处的深度信息h(x, y)求出,即

| $ h\left( {x,y} \right) = - \frac{{{L_0} \times \Delta \varphi \left( {x,y} \right)}}{{2{\rm{ \mathsf{ π} }}{f_0}d + \Delta \varphi \left( {x,y} \right)}}. $ | (2) |

基于正弦条纹光栅图像的结构光三维测量方法,关键在于根据三角形原理和正弦条纹光栅的相位特性求取被测物体表面各点的深度信息和该点所对应的相位值之间的关系.根据测量原理,求取摄像机捕获的条纹光栅图像的相位,便可得到被测量物体的深度信息.下面对该方法中的相位提取和相位解包裹运算步骤进行介绍.

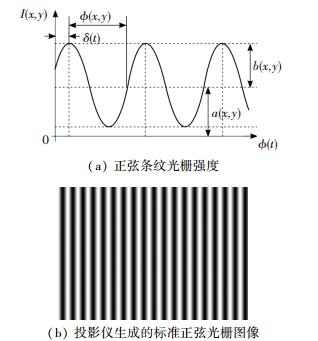

1.2.1 相位提取常用的相位提取方法主要有相移法、傅里叶变换法、卷积解调法等.使用傅立叶变换法和卷积解调法对相位进行提取均要把被测场景中的背景光强和噪声给最大程度地滤除掉,测量精度受当前滤波技术水平的限制并不是很高,两者应用范围都比较小[11].在使用结构光法进行三维测量时,通常会采用相移法,即向被测量的物体表面投射多幅正弦条纹光栅图像,然后用相机捕获这些光栅图像,最后对其进行处理计算得到其绝对相位的方法,如图 3所示.该方法计算时可以跳过某些深度信息比较低的点,分辨率较高,鲁棒性相对较好,测量精度高[12].

|

图 3 正弦条纹光栅图像 Figure 3 Sinusoidal fringe grating images |

相机捕获图像的光强分布为

| $ {I_n}\left( {x,y} \right) = a\left( {x,y} \right) + b\left( {x,y} \right)\cos \left[ {\varphi \left( {x,y} \right) + \delta \left( t \right)} \right]. $ | (3) |

式中:a(x, y)为测量环境中的背景光强,b(x, y)为调制的正弦条纹光栅图像的幅值,φ(x, y)为被测量的物体表面像素点(x, y)处的相位值,δ(t)为根据计算的方法和相移的步数确定的相位偏移角度.

式(3)中只有相移角度δ(t)为已知变量.相机捕获的条纹光栅图像中像素点的相位值φ(x, y)包含被测量的物体的深度信息.因此,向被测量物体表面投射3幅以上不同相位角度的条纹光栅图像,求出未知变量,然后计算出捕获图像中各个像素点相位值的分布,获得被测量的物体的深度信息,便可获得被测物体的三维轮廓信息[13].

使用投影仪投射N幅等相位差的条纹光栅图像时的相移法称为N步相移法. N步相移法的相位分布为

| $ {I_i}\left( {x,y} \right) = a\left( {x,y} \right) + b\left( {x,y} \right)\cos \left[ {\varphi \left( {x,y} \right) + {\delta _i}} \right], $ | (4) |

| $ {\delta _i} = \frac{{2{\rm{ \mathsf{ π} }}i}}{N}. $ | (5) |

式中δi为在不同的相移步数下确定的相位角度值,i=1、2、3、…、N,N≥3.

使用最小二乘法对N步相移算法的相位分布进行计算,得到的包裹相位为

| $ \varphi \left( {x,y} \right) = - \arctan \frac{{\sum\limits_{i = 1}^N {{I_i}\left( {x,y} \right)\sin {\delta _i}} }}{{\sum\limits_{i = 1}^N {{I_i}\left( {x,y} \right)\cos {\delta _i}} }}. $ | (6) |

本文使用反正切函数提取相位,通过计算得出的相位值为包裹相位值,它与真实相位值存在2kπ的相位差(k为任意整数).对求得的包裹相位值进行加减2kπ的解包裹计算,求得的连续的真实相位值就是绝对相位,整个求取过程就被称作相位解包裹或相位展开.通常选包裹相位图中的某一点作起始位置,按照特定的展开路径进行相位展开,便可求出绝对相位图[14]如图 4所示.

|

图 4 包裹相位与解包裹相位示意图 Figure 4 Schematic diagrams of wrapped phase and unwrapped phase |

若利用四步相移法求取包裹相位图,比较图中相邻两点的相位值.任意连续的两个相位点,它们相位的差值不会超过±π.当相邻两个像素点不连续时,相位值差值的绝对值会大于π,此时通过加上或者减去2π的整数倍的方法来使得这两个像素点的相位连续[15].

2 正弦光栅测量误差矫正算法 2.1 正弦光栅测量的gamma畸变问题受背景光强,gamma畸变以及光强饱和程度等因素的干扰,正弦条纹光栅的实际测量会产生一定误差.由相机和投影仪等硬件设备产生的非线性畸变叫gamma畸变,会使经相机捕获的条纹光栅投影不能很好的满足正弦性质,产生非正弦波形[16].相较于更换硬件设备解决gamma畸变,选择从软件角度来解决畸变具有成本小、受测量局限性影响小等优点.

gamma值预编码法的优点是理论简单,但需要计算系统的gamma值,由于gamma值与区域分布有关,计算复杂,纠正误差能力不高;投影仪散焦法具备低通滤波的效果,能滤除高次谐波,可往往会忽略测量中的其他噪声影响,提高的测量精度有限;相位迭代法通过多次迭代得到更为理想的相位值,虽能提高一定的测量精度,可收敛条件有待深入考虑;排除误差法、双三步相移法、高次谐波消除法、基于梯度相移的二次谐波保留法、基于神经理论的矫正法等,均需要投射5或6幅以上的条纹光栅图像,影响了算法的实时性[17].而本文提出的基于相位偏移的gamma矫正法具有精度高、计算量小的优势.

2.2 基于相位偏移法的gamma矫正法 2.2.1 无gamma畸变时的包裹相位无gamma畸变时,正弦条纹光栅的强度和包裹相位φ可表示为[18]

| $ I_n^p = {A^p} + {B^p}\cos \left( {2{\rm{ \mathsf{ π} }}f{x^p} + \frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right), $ | (7) |

| $ \varphi = - \arctan\frac{{\sum\nolimits_{n = 0}^{N - 1} {I_n^c\sin \left( {\frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right)} }}{{\sum\nolimits_{n = 0}^{N - 1} {I_n^c\cos \left( {\frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right)} }}. $ | (8) |

式中:Inc为光栅强度,Ap为测量环境中背景光的强度值,Bp为光强的幅值,f为正弦条纹光栅的频率,n为相移的指数,N为总的相移图案的数量,相位φ和像素横坐标xp的关系为φ=2πfxp.

根据求取出来的相位值φ,及与该相位所对应的相机捕获的条纹光栅图像的坐标(xp, yp),通过三角测量的原理求取被测量物体的三维轮廓信息,从而实现被测量物体的三维重构.

2.2.2 gamma模型的建立当考虑gamma畸变影响时,相机捕获的非线性条纹光栅图像强度表达式[19]为

| $ I_{n,c}^\gamma = \alpha {\left[ {M + N\cos \left( {\varphi + \frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right)} \right]^\gamma }. $ | (9) |

式中:In, cγ为相机捕获的带gamma畸变的条纹光栅图像的强度值,α∈[0, 1]为被测量的物体的反射率,M和N分别为规范化的平均强度及调制强度,γ为照相机-投影仪系统的gamma值(γ≥1).式(9)还可表示为

| $ I_{n,c}^\gamma = \alpha {M^\gamma }{\left[ {1 + p\cos \left( {\varphi + \frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right)} \right]^\gamma }. $ | (10) |

式中p=N/M为调制强度与平均强度的比值.对于式(10),当γ=1.0时,就相当于不存在gamma畸变的情况.将式(10)进行傅立叶级数展开、简化,得到gamma畸变的数学模型为

| $ I_{n,\gamma }^c = A + \sum\limits_{k = 1}^\infty {{B_k}\cos \left[ {k\left( {\varphi + \frac{{2{\rm{ \mathsf{ π} }}n}}{N}} \right)} \right]} . $ | (11) |

式中k为所有非负的整数,而且

| $ A = 0.5{B_0}, $ | (12) |

| $ {B_k} = 2{M^\gamma }\sum\limits_{m = 0}^\infty {{b_{k,m}}} , $ | (13) |

| $ {b_{k,m}} = {\left( {0.5p} \right)^{2m + k}}\left( {\begin{array}{*{20}{c}} \gamma \\ {2m + k} \end{array}} \right)\left( {\begin{array}{*{20}{c}} {2m + k}\\ m \end{array}} \right). $ | (14) |

本文用四步相移方法对包裹相位进行相位展开来求取误差.将式(7)代入式(8)中求出理想相位φi,将式(11)代入式(8)中求出实际相位φ.相位误差通过Δφ=φ-φi求取.根据二项式级数的特点,如果γ为整数,而且γ≥1,那么当满足k>γ的条件时,Bk=0.而如果γ不为整数,那么Bk就是收敛的无限级数的和.通过实验数据得知,不管P取何值,Bk的值会随着k值的增大而迅速的减小.

为了更精确分析相位误差的模型,利用三角函数的公式对Δφ进行展开操作时,只考虑8次谐波以内的谐波分量,更高次谐波因数值过小,可以忽略不计.相位误差Δφ可表示为

| $ \Delta \varphi \approx - \arctan \frac{{q \cdot \sin 4\varphi - r \cdot \sin 4\varphi + s \cdot \sin 8\varphi }}{{1 + q \cdot \cos 4\varphi + r \cdot \cos 4\varphi + s \cdot \cos 8\varphi }}. $ | (15) |

式中:q=B3/B1,r=B5/B1,s=B7/B1.

然后,根据泰勒公式展开的性质,对等式进行泰勒公式展开,可得公式

| $ \begin{array}{l} \Delta \varphi \approx \left( { - q + r + rs} \right)\sin 4\varphi + \left( {\frac{{{q^2}}}{2} - \frac{{{r^2}}}{2} - s} \right)\sin 8\varphi + \\ \;\;\;\;\;\;\;\;\;qs\sin 12\varphi + \frac{{{s^2}}}{2}\sin 16\varphi . \end{array} $ | (16) |

由于

| $ \Delta \varphi \approx - q\sin 4\varphi + \frac{{{q^2}}}{2}\sin 8\varphi . $ | (17) |

本文设计了一种新算法来减少由测量设备的gamma非线性所引起的相位误差,由式(17)可知,该误差是由相位φ和参数q共同决定的,若在相位偏移条纹图案中引入一个初始相位偏移,那么相位误差也会相应变化.引入3组初始相位偏移分别为-π/4,-3π/8,3π/8的条纹光栅图像,其各自对应的包裹相位图的相位误差将会变为

| $ \Delta {\varphi _1} = \Delta \left( {\varphi - {\rm{ \mathsf{ π} }}/4} \right) = q\sin 4\varphi + \frac{{{q^2}}}{2}\sin 8\varphi , $ | (18) |

| $ \Delta {\varphi _2} = \Delta \left( {\varphi - 3{\rm{ \mathsf{ π} }}/8} \right) = - q\cos 4\varphi - \frac{{{q^2}}}{2}\sin 8\varphi , $ | (19) |

| $ \Delta {\varphi _3} = \Delta \left( {\varphi + 3{\rm{ \mathsf{ π} }}/8} \right) = q\cos 4\varphi - \frac{{{q^2}}}{2}\sin 8\varphi . $ | (20) |

相位误差满足Δφ+Δφ1+Δφ2+Δφ3=0的特点.因此,如果分别投影4组具有0,-π/4,-3π/8,3π/8初始相位偏移、相角差为90°的正弦条纹光栅图像,然后用四步相移法将它们的包裹相位值分别求取出来,并将这四组的包裹相位值相加,求出相位平均值,这样便可以消除由于测量设备的gamma非线性引起的相位误差,实现矫正.

2.3 基于相位偏移法的gamma矫正实验 2.3.1 结构光三维测量系统的组成本文实验的测量系统由投影仪、摄相机、计算机、人脸头像雕塑等组成.采用戴尔M110微型投影仪,设备分辨率为1 024像素×768像素.通过使用计算机进行软件编程,可以生成不同波长的具有不同相位角度值的正弦条纹光栅图像.采用大恒DH-HV2051UC数字摄像机,设备分辨率为1 600像素×1 200像素.使用笔记本电脑保存相机捕获的变形条纹光栅图像和投影仪投射的标准正弦条纹光栅图像,用MATLAB程序进行图像处理.

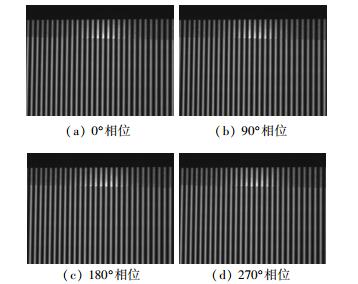

2.3.2 正弦条纹光栅图像的生成实验采用四步相移法,需投射四组初始相位偏移角分别为0°、-45°、-67.5°和67.5°的正弦条纹光栅图像,而每组又包含4幅图像,其相角差为90°. 表 1为4组4幅正弦条纹光栅图像所对应的相位角.

| 表 1 4组4幅正弦条纹光栅图像所对应的相位角 Table 1 The phase angle of four groups of four sinusoidal fringe grating images |

相机捕获的初始相位为0°偏移的包裹相位图如图 5所示,4幅图像的相位分别为0°、90°、180°、270°,条纹宽度为32像素.

|

图 5 相机捕获图像 Figure 5 The camera captured images |

对相机捕获的图像使用四步相移法进行相位展开,本文在求取包裹相位图是用正弦竖条纹光栅图像,这些条纹光栅图像在被测物体表面会发生变形,假设,由相机捕获的4幅经过被测物体表面调制的变形的条纹光栅图像分别为I1、I2、I3、I4,那么在像素点(i, j)处,当相位初始偏移角度为0°时有

| $ y = {I_4}\left( {i,j} \right) - {I_2}\left( {i,j} \right), $ | (21) |

| $ x = {I_1}\left( {i,j} \right) - {I_3}\left( {i,j} \right). $ | (22) |

当相位初始偏移角度为-45°时有

| $ y = {I_1}\left( {i,j} \right) - {I_2}\left( {i,j} \right) - {I_3}\left( {i,j} \right) + {I_4}\left( {i,j} \right), $ | (23) |

| $ x = {I_1}\left( {i,j} \right) + {I_2}\left( {i,j} \right) - {I_3}\left( {i,j} \right) - {I_4}\left( {i,j} \right). $ | (24) |

当相位初始偏移角度为-67.5°时有

| $ \begin{array}{l} y = \sqrt {2 + \sqrt 2 } \left( {{I_1}\left( {i,j} \right) - {I_3}\left( {i,j} \right)} \right) + \\ \;\;\;\;\;\;\;\sqrt {2 - \sqrt 2 } \left( {{I_4}\left( {i,j} \right) - {I_2}\left( {i,j} \right)} \right), \end{array} $ | (25) |

| $ \begin{array}{l} x = \sqrt {2 + \sqrt 2 } \left( {{I_2}\left( {i,j} \right) - {I_4}\left( {i,j} \right)} \right) + \\ \;\;\;\;\;\;\;\sqrt {2 - \sqrt 2 } \left( {{I_1}\left( {i,j} \right) - {I_3}\left( {i,j} \right)} \right). \end{array} $ | (26) |

当相位初始偏移角度为67.5°时有

| $ \begin{array}{l} y = \sqrt {2 + \sqrt 2 } \left( {{I_3}\left( {i,j} \right) - {I_1}\left( {i,j} \right)} \right) + \\ \;\;\;\;\;\;\;\sqrt {2 - \sqrt 2 } \left( {{I_4}\left( {i,j} \right) - {I_2}\left( {i,j} \right)} \right), \end{array} $ | (27) |

| $ \begin{array}{l} x = \sqrt {2 + \sqrt 2 } \left( {{I_4}\left( {i,j} \right) - {I_2}\left( {i,j} \right)} \right) + \\ \;\;\;\;\;\;\;\sqrt {2 - \sqrt 2 } \left( {{I_1}\left( {i,j} \right) - {I_3}\left( {i,j} \right)} \right). \end{array} $ | (28) |

在像素点(i, j)处,求得的包裹相位值为

| $ M\left( {i,j} \right) = \arctan \frac{y}{x}. $ | (29) |

经过简单的处理,将得到的结果变换到[0, 2π),最终得到包裹相位的波形图,如图 6(a)所示.通过把包裹相位与理想相位进行比较计算,求出包裹相位的相位误差,如图 6(c)所示.使用基于相位偏移法的gamma矫正法对相位误差进行矫正,矫正后的相位波形如图 6(b)、6(d).

|

图 6 矫正前后的包裹相位波形和相位误差 Figure 6 Before and after the correction of wrapped phase waveform and phase error |

本文实验采用基于相位偏移法的gamma矫正方法和基于相位迭代法的gamma矫正方法分别对条纹宽度为32像素、48像素和90像素的条纹光栅图像的包裹相位进行了误差矫正. 表 2为本文提出的相位偏移法矫正前后的相位误差RMS比较,表 3为相位迭代法矫正前后的相位误差RMS的比较,通过对比可知,相位偏移矫正方法能较为有效地降低gamma畸变所引起的相位误差,精度较相位迭代方法高.

| 表 2 相位偏移方法矫正前后的误差情况 Table 2 The error of phase shift method before and after correction |

| 表 3 相位迭代方法矫正前后的误差情况 Table 3 The error of phase iterative method before and after correction |

为了验证本文中介绍的gamma矫正方法,选用上文提到的矫正方法实验测量系统里的人脸头像雕塑作为三维测量实验的对象.

首先,用投影仪向被测量物体表面投射条纹宽度为16像素的正弦条纹光栅图像,并用相机捕获经过被测量的物体表面调制的变形的条纹光栅图像.然后,用四步相移方法将相机捕获图像的包裹相位图给求取出来,根据相位解包裹的方法原理把被测量的物体的绝对相位图给求取出来.最后进行三维重构,获得被测量物体的三维数据.

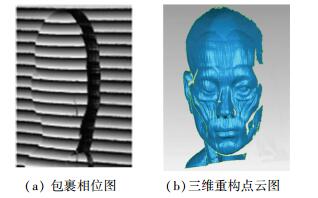

按上述步骤,先用普通三维测量方法,没有对gamma畸变造成的相位误差进行矫正操作,投影仪投射的正弦条纹光栅的图像的相位角度值为0°、90°、180°、270°,图 7为未进行矫正的情况下得到的三维重构点云图,从该图可知,被测量的物体在三维重构之后会出现比较明显的波浪形畸变现象,该现象产生的原因正是条纹光栅图像的gamma畸变.

|

图 7 未进行矫正的情况下得到的三维重构点云图 Figure 7 3D reconstruction point cloud without gamma correction |

采用本文设计的基于相位偏移法的gamma矫正方法来对gamma畸变造成的相位误差进行矫正,用投影仪投射4组初始相位偏移分别为0°、-45°、-67.5°、67.5°的正弦条纹光栅图像,将矫正后的包裹相位求取出来,得到的包裹相位图如图 8(a)所示,完成对被测量物体的三维重构操作,得到的三维重构点云图像如图 8(b)所示.

|

图 8 基于相位偏移方法的gamma矫正的三维重构 Figure 8 3D reconstruction with gamma correction based on phase shift method |

根据得到的重构结果,通过与图 7进行对比可以发现,之前人脸头像雕像中存在的波浪形畸变在经过基于相位偏移法的gamma矫正方法矫正后畸变程度明显减小,从而可以验证该矫正方法的有效性.

4 结论1) 利用四步相移方法对包裹相位进行计算,针对相机和投影仪产生的gamma畸变的影响提出了基于相位偏移法的gamma误差矫正方法.

2) 所设计的误差矫正方法提高了正弦条纹光栅的测量精度,为获得准确的物体表面信息奠定了基础.

3) 通过与基于相位迭代法的gamma矫正方法的实验比较说明所设计的矫正方法稳定可靠,精度高,能较好地消除波浪形畸变现象,具有一定的可行性.

| [1] |

孙宇臣, 葛宝臻, 张以谟. 物体三维信息测量技术综述[J].

光电子·激光, 2004, 15(2): 248-254.

SUN Yuchen, GE Baozhen, ZHANG Yimo. Review for the 3D information measuring technology[J]. Journal of Optoelectronics·Laser, 2004, 15(2): 248-254. DOI: 10.3321/j.issn:1005-0086.2004.02.031 |

| [2] |

CHEN F, BROWN G M, SONG M. Overview of three-dimensional shape measurement using optical methods[J].

Optical Engineering, 2000, 39(1): 10-22.

DOI: 10.1117/1.602438 |

| [3] |

冯宇. 基于计算机立体视觉的三维重建系统研究[D]. 青岛: 青岛科技大学, 2009. DOI: 10.7666/d.y1456702.

FENG Yu. Study on the system of three-dimensional reconstruction based on computer stereo vision[D]. Qingdao:Qingdao University of Science & Technology, 2009.DOI: 10.7666/d.y1456702. 10. 7666/d. y1456702 |

| [4] |

董欢. 基于傅里叶变换轮廓术的光学三维形貌测量技术的研究[D]. 辽宁: 辽宁师范大学, 2012. DOI: 10.7666/d.Y2233507

DONG Huan.3D shape measurement studies based on fourier transform profilometry[D]. Liaoning:Liaoning Normal University, 2012. DOI: 10.7666/d.Y223350. 10. 7666/d. Y223350 |

| [5] |

陈晓波. 结构光三维测量系统误差分析、控制及补偿技术的研究[D]. 上海: 上海交通大学, 2009.

CHEN Xiaobo. Error analysis, control and compensation for a structured light measurement system[D]. Shanghai:Shanghai Jiao Tong University, 2009. http: //d. wanfangdata. com. cn/Thesis/Y1605806 |

| [6] |

郑东亮, 达飞鹏. 提高数字光栅投影测量系统精度的gamma矫正技术[J].

光学学报, 2011, 5(31): 116-121.

ZHENG Dongliang, DA Feipeng. Gamma correction method for accuracy enhancement in grating projection profilometry[J]. Acta Optica Sinica, 2011, 5(31): 116-121. DOI: 10.3788/AOS201131.0512003 |

| [7] |

吕江昭. 基于散焦光栅投影的快速三维测量若干关键技术研究[D]. 南京: 东南大学, 2015.

LV Jiangzhao.Research on some key technologies in high-speed three-dimensional measurement based on defocused fringe projection[D]. Nanjing: Southeast University, 2015. http: //cdmd. cnki. com. cn/Article/CDMD-10286-1016755164. htm |

| [8] |

黄利新, 姚新, 蔡冬梅, 等. 一种快速高精度的相位恢复迭代法[J].

中国激光, 2010, 5(37): 1218-1221.

HUANG Lixin, YAO Xin, CAI Dongmei, et al. A high accuracy and fast iterative algorithm for phase retrieval[J]. Chinese Journal of Lasers, 2010, 5(37): 1218-1221. DOI: 10.3788/CJL20103705.1218 |

| [9] |

陆军, 李积江, 黄春明. 符号M阵列结构光的解码[J].

光学精密工程, 2013, 21(4): 1069-1078.

LU Jun, LI Jijiang, HUANG Chunming. Decoding of structred light based on symbol M-array[J]. Optics and Precision Engineering, 2013, 21(4): 1069-1078. DOI: 10.3788/OPE.20132104.1069 |

| [10] |

付强. 扩大景深的波前编码系统成像特性研究[D]. 哈尔滨: 哈尔滨工业大学, 2010.

FU Qiang.Property research on wavefront coding imaging systems for extanding the depth of field[D]. Harbin:Journal of Harbin Institute of technology, 2010. http: //cdmd. cnki. com. cn/Article/CDMD-10213-1011261485. htm |

| [11] |

HUANG P S, HU Q J, CHIANG F P. Double three-step phase-shifting algorithm[J].

Applied Optics, 2002, 41(22): 4503-4509.

DOI: 10.1364/AO.41.004503 |

| [12] |

LEITGEB R A, HITZENBERGER C K, FERCHER A F, et al. Novel phase-shifting algorithm to achieve high-speed long-depth range probing by frequency domain optical coherence tomography[J].

Optics Letters, 2003, 28(22): 2201-2203.

DOI: 10.1364/OL.28.002201 |

| [13] |

HESHMAT S, TOMIOKA S, NISHIYAMA S. Phase unwrapping algorithm based on singularity compensation for three-dimensional shape measurement[J].

Optical Review, 2012, 19(6): 444-450.

DOI: 10.1007/s10043-012-0076-9 |

| [14] |

LI Yang, CAOYiping, HUANG Zhenfen, et al. A three dimensional on-line measurement method based on five unequal steps phase shifting[J].

Optics Communications, 2012, 285(21/22): 4285-4289.

DOI: 10.1016/j.optcom.2012.06.062 |

| [15] |

CHEN K, XI J, YU Y, et al. Fast quality-guided flood-fill phase unwrapping algorithm for three-dimensional fringe pattern profilometry[C]//Photonics Asia 2010 International Society for Optics and Photonics. Beijing: SPIE, 2010: 78550X-1-78550X-9.

http://spie.org/x648.xml?product_id=870232

|

| [16] |

SONG Z, PEISEN H. Phase error compensation for a 3-D shape measurement system based on the phase-shifting method[J].

Optical Engineering, 2007, 46(6): 063601-1.

DOI: 10.1117/1.2746814 |

| [17] |

郑东亮, 达飞鹏. 双步相移光栅投影测量轮廓术[J].

光学学报, 2012, 5(32): 86-92.

ZHENG Dongliang, DA Feipeng. Double-step phase-shifting algorithm for fringe-projection measurement[J]. Acta Optica Sinica, 2012, 5(32): 86-92. DOI: 10.3788/AOS201232.0512004 |

| [18] |

HUO Jincheng, WU Qingyang, ZENG Xiangjun. A technique of phase-shifting for 3-D measurement using spectral-transform[J].

Optics and Lasers in Engineering, 2013, 51(10): 1133-1137.

DOI: 10.1016/j.optlaseng.2013.04.014 |

| [19] |

YE Xu, CHENG Haobo, WU Hengyu, et al. Gamma correction for three-dimensional object measurement by phase measuring profilometry[J].

Optik-International Journal for Light and Electron Optics, 2015, 126(24): 5534-5538.

DOI: 10.1016/j.ijleo.2015.09.028 |

2017, Vol. 49

2017, Vol. 49