2. 大连理工大学 计算机科学与技术学院,辽宁 大连 116024

2. School of Computer Science and Technology, Dalian University of Technology, Dalian 116024, Liaoning, China

随着互联网的不断发展,网络提供的服务日益多样化,网络环境越来越复杂。如何优化网络结构、保障网络稳定运行成为网络领域中急需解决的问题。传统网络管理模式由于架构的限制对网络进行调度优化越来越困难。而软件定义网络(software-defined networking,SDN)将网络中的控制平面和数据平面分开,控制平面可以采集数据平面的数据从而进行预测,然后基于链路状态生成控制策略。控制策略通过流表下发至交换机,交换机根据流表信息控制数据转发最终实现网络调度优化。流量预测被部署于控制平面内,是网络调度的基础。研究精准实时的流量预测算法对路由调度、优化网络设计、保证网络服务质量、提升用户体验等具有重要意义。

一般而言,网络流量使用流量矩阵表示。流量OD(origin destination)矩阵表示网络节点之间的流量,即特定时间点网络中所有的原始和目的节点对之间的流量。流量预测方法分为模型驱动和数据驱动两类。模型驱动是根据先验知识对网络进行系统建模从而实现预测,但是其无法应对复杂的动态网络,所以数据驱动是目前研究的热点。其中基于统计学的方法是根据已知数据得到最优回归函数实现预测,最常用的是整合移动平均自回归(autoregressive integrated moving average, ARIMA)模型。文献[1-3]将ARIMA方法用于流量预测。但ARIMA模型要求数据具有平稳性,不适用于快速变化的网络。而基于数据特征进行预测的方法如有支持向量回归(support vector regression, SVR)、K-最近邻算法(K-nearest neighbors, KNN)、贝叶斯网络模型、神经网络模型等具有更好的适应性。文献[4]第一次提出使用SVR进行链路负载的预测。

近些年,随着深度学习的快速发展,越来越多的神经网络模型被应用于流量预测并且取得较好的预测效果。文献[5-6]将BP神经网络和深度置信网络应用于预测任务中,证明两者在网络流量预测中优于传统方法。循环神经网络(recurrent neural network,RNN)和基于RNN的长短期记忆网络(long short-term memory,LSTM)和门控循环神经网络(gated recurrent unit,GRU)都使用递归循环机制执行时间序列任务。文献[7-9]将RNN、LSTM、GRU等模型应用于GEANT、ABILENE、Ties-1等真实网络流量中,证明LSTM和GRU比RNN更加适合流量预测任务。还有一些工作是基于RNN的改进,例如文献[10]在LSTM中增加星期、月份等额外的时间信息,文献[11]将注意力机制应用于GRU中,文献[12]将GRU单元进行堆叠和增加短连接结构,文献[13]使用遗传算法对LSTM超参数进行优化,文献[14-16]对流量数据进行小波分解等预处理后再进行预测。这些工作通过缓解梯度问题、优化超参数、进行数据预处理等方法提高预测精度。

上述方法只考虑到流量数据的时间特征,却忽略了邻近网络节点之间会互相影响,即忽略了流量的空间特征。所以文献[17]等工作使用卷积神经网络(convolutional neural network, CNN)或图卷积神经网络(graph convolution neural network, GCN)提取数据空间特征以提升预测效果。例如,文献[18-20]将GRU与GCN相结合提取时空特征从而进行流量预测。还有一些工作是基于GCN的改进。文献[21]将邻接矩阵加权来表示实际节点间的距离。文献[22]将注意力机制应用于GCN中,使模型关注于某些重要节点。还有工作利用其他方式进行空间特征提取。文献[23-24]使用CNN提取空间特征。文献[25]利用扩散卷积对空间特征进行建模提取。文献[26]通过时空注意力使模型关注到重要的节点和时刻。

现有方法虽然取得一定成果,但仍存在一些不足。例如,基于RNN的模型相较于BP神经网络有更强的时序特征提取能力,但RNN本身的递归循环结构使模型很难对较长历史时刻的特征进行提取,导致模型对长期依赖的建模能力不足。同时流量数据具有时间和空间两种特征,但现有方法基本上采用串行结构依次提取。这类方法在提取空间特征的同时,数据的时间特征可能受到影响,这不利于时空特征的完整提取。且串行结构在实际设备中运行速度较慢,难以满足预测控制任务的实时要求。

为了解决上述问题,提升模型的预测效果和运行速度。本文提出一种新型的基于时空特征融合的神经网络(spatial-temporal features fusion, ST-Fusion)进行流量预测。模型采用编码器-解码器结构,其编码器由GRU和self-attention组成的时间编码器和基于GCN的空间编码器组成。它能够在时间、空间两个特征上同时捕捉流量的时空特征,然后通过双边门限机制进行自适应地特征融合。解码器则使用GRU进行递归循环生成预测结果。

1 前提 1.1 GRU结构GRU在RNN的基础上增加门控结构,使信息能够选择性地在隐藏层传递,通过只保留重要信息来解决长序列训练过程中可能出现的梯度消失和梯度爆炸问题。GRU有重置门和更新门两个门控结构,相较于RNN具有参数少且收敛快等特点。

GRU的数学表达式为

| $ u_t=\sigma\left(\boldsymbol{W}_{\mathrm{u}}\left[\boldsymbol{X}_t, h_{t-1}\right]+b_{\mathrm{u}}\right) $ | (1) |

| $ r_t=\sigma\left(\boldsymbol{W}_{\mathrm{r}}\left[\boldsymbol{X}_t, h_{t-1}\right]+b_{\mathrm{r}}\right) $ | (2) |

| $ c_t=\tanh \left(\boldsymbol{W}_{\mathrm{c}}\left[\boldsymbol{X}_t, r_t \cdot h_{t-1}\right]+b_{\mathrm{c}}\right) $ | (3) |

| $ h_t=u_t \cdot h_{t-1}+\left(1-u_t\right) \cdot c_t $ | (4) |

式中:ht为时刻t的隐层状态;Xt为时刻t的流量信息; rt为重置门,表征忽略前一时刻信息的程度; ut是更新门,表征上一时刻信息影响这一时刻的程度;ct是时刻t的记忆内容; Ht+1是时刻t+1的输出状态。GRU利用时刻t的隐藏状态和当前输入去预测t+1时刻的流量状态。

1.2 自注意力机制循环神经网络常用于解决非线性时间序列的预测问题。但RNN采用递归结构导致无法并行计算,且较难捕获序列的长期依赖关系。因此,越来越多的研究者采用注意力机制进行序列建模。其中基于自注意力机制的Transformer模型以并行方式输入数据,且并行执行所以不存在长期依赖问题。

由于Transformer采用并行注意力机制,这种机制会使数据失去序列信息。而在时序任务中序列的时序信息至关重要。所以在执行自注意力机制之前,首先对数据进行位置编码,即将时序信息注入到输入序列当中,如下:

| $ \boldsymbol{u}_{p, 2 i}=\sin \left(p / 10000^{2 i / d_{\text {model }}}\right) $ | (5) |

| $ \boldsymbol{u}_{p, 2 i+1}=\cos \left(p / 10000^{2 i / d_{\text {model }}}\right) $ | (6) |

式中:u为嵌入向量,p为特征向量的位置; dmodel为特征向量的维度,每一个特征向量的位置编码都是由不同频率的余弦正弦函数组成,波长逐渐由2π增长到10 000·2π。

多头注意力主要由单头注意力组成,单头注意力是一种点积注意力,其通过缩放点积注意力来计算特征矩阵的注意力值。点积注意力的输入由一组查询、键、值组成,其中d代表输入数据特征维度,计算查询和键的点积后除以

| $ \operatorname{Attention}(\boldsymbol{Q}, \boldsymbol{K}, \boldsymbol{V})=\operatorname{softmax}\left(\frac{\boldsymbol{Q} \boldsymbol{K}^{\mathrm{T}}}{\sqrt{d}}\right) \boldsymbol{V} $ | (7) |

式中:Q =[q1, q2, …, qn]∈Rn×d、K =[k1, k2, …, kn]∈Rn×d、V =[v1, v2, …, vn]∈Rn×d分别为查询、键和值,n为个数。其中利用线性映射将节点的特征矩阵映射到查询、键、值3个向量上,即:Q = XWQ、K = XWK、V= XWV其中WQ, WK, WV∈Rd×dh,则自注意力可以表示为

| $ \text { Attention }(\boldsymbol{Q}, \boldsymbol{K}, \boldsymbol{V})=\operatorname{softmax}\left(\frac{\left(\boldsymbol{X} \boldsymbol{W}^{\mathrm{Q}}\right)\left(\boldsymbol{X} \boldsymbol{W}^{\mathrm{K}}\right)^{\mathrm{T}}}{\sqrt{d}}\right)\left(\boldsymbol{X} \boldsymbol{W}^{\mathrm{V}}\right) $ | (8) |

自注意力机制可以使模型学习注意到输入特征的某一方面的信息,但是单一的注意力机制只能注意到单一信息,为了使模型同时注意多个方面的特征,一般采用多头自注意力机制来进行注意学习。多头自注意力机制由多个单头自注意力机制拼接后线性映射得到。多头自注意力公式如下所示:

| $ \operatorname{MultiHead}(\boldsymbol{Q}, \boldsymbol{K}, \boldsymbol{V})=\operatorname{Concat}\left(h_1, h_2, \cdots, h_h\right) \boldsymbol{W} $ | (9) |

| $ h_i=\operatorname{Attention}\left(\boldsymbol{X} \boldsymbol{W}_i^{\mathrm{Q}}, \boldsymbol{X} \boldsymbol{W}_i^{\mathrm{K}}, \boldsymbol{X} \boldsymbol{W}_i^{\mathrm{V}}\right) $ | (10) |

式中:WiQ, WiK, WiV∈Rd×dh是第i个注意力头Q、K、V的权重矩阵; W ∈Rh×dh×d是多头注意力权重矩阵; h为注意力头的数量; dh为每一个头的输出特征维度; Concat函数为拼接,用于拼接单头注意力的结果。

1.3 图卷积神经网络给定一个邻接矩阵A和特征矩阵X,GCN在傅里叶域内构造一个滤波器,该滤波器作用于图中的节点,通过对其一阶领域进行卷积从而捕获节点之间的空间特征,可表示为

| $ \boldsymbol{H}^{(l+1)}=\sigma\left(\boldsymbol{D}^{-\frac{1}{2}} \hat{\boldsymbol{A}} \boldsymbol{D}^{-\frac{1}{2}} \boldsymbol{H}^{(i)} \theta^{(i)}\right) $ | (11) |

式中:

网络流量预测任务可以看作是一个图结构数据的预测任务。本文使用非加权图G=(V, E)来描述网络拓扑结构,其中V为顶点集,即网络中路由交换机等网络节点的集合; E为边集,即节点之间链路的集合; N为节点总数。网络拓扑结构的邻接矩阵定义为A∈RN×N,其中元素的取值为0或1。若节点之间没有链路连接,其该位置元素为0,否则为1。网络OD流量矩阵Xt∈RN×N是t时刻节点的特征矩阵,将网络中的节点的流量信息作为节点的特征。

综上所述,流量预测任务被描述为: 基于拓扑G和若干特征矩阵X,训练得到一个的映射f,去预测得到未来T个时间步的流量矩阵,即

| $ \left[\boldsymbol{X}_{t+1}, \boldsymbol{X}_{t+2}, \cdots, \boldsymbol{X}_{t+T}\right]=f\left[G, \left(\boldsymbol{X}_{t-n+1}, \boldsymbol{X}_{t-n+2}, \cdots, \boldsymbol{X}_t\right)\right] $ | (12) |

式中:n为输入时间序列的长度,T为输出时间序列的长度。

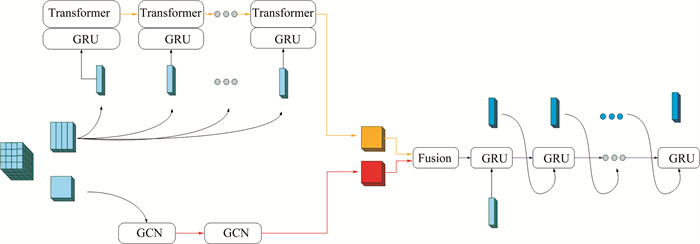

2.2 ST-Fusion模型框架在本文中,ST-Fusion模型如图 1所示,其由时间编码器、空间编码器、融合单元、预测解码器组成。首先将历史N个网络流量矩阵作为输入,分别通过空间编码器和时间编码器提取流量矩阵的空间特征和时间特征。其中时间编码器使用GRU和自注意力机制依次提取时间特征的短期和长期依赖,空间编码器使用GCN来捕获网络流量的空间特征,从而获得空间依赖。然后融合单元采用双边门控注意融合机制对编码器得到的特征进行融合,最终使用GRU递归解码输出预测结果。训练过程中使用平均绝对误差优化整个网络。

|

图 1 ST-Fusion网络流量预测模型 Fig. 1 ST-Fusion network flow prediction model |

由于网络流量数据是典型的时空数据,即流量具有时间和空间两个维度的特征。本文设计一个双路编码器,即时间编码器和空间编码器,来并行提取流量的时间特征和空间特征。

2.3.1 时间编码器时间编码器用于提取网络流量矩阵的时间特征。由于GRU网络是一种递归结构,这种结构可以较好地捕捉短期流量特征,但无法有效捕捉长期流量特征,所以本文采用自注意力机制再次捕捉GRU输出状态的时间特征,从而增强模型捕捉流量数据长期特征的能力。

时间编码器的输入数据为X,定义为

| $ \boldsymbol{X}=(N, H) $ | (13) |

式中:N为网络中的节点个数,H为历史流量数据的个数。

首先,流量数据被送入GRU层,其初步提取流量的时间特征,其中GRU的计算步骤见式(1)~(4)。

| $ \boldsymbol{F}_1=\operatorname{GRU}(\boldsymbol{X}) $ | (14) |

然后将初步提取到的特征数据输入到基于自注意力机制的Transformer中。Transformer部分由基本块堆叠而成,可再次进行特征提取。本文仅以第l个块的输出为例。首先输入到l+1模块中的多头自注意力模块

| $ \boldsymbol{M}^{l+1}=\operatorname{MultiHead}\left(\boldsymbol{O}^l, \boldsymbol{O}^l, \boldsymbol{O}^l\right) $ | (15) |

式中: Ml+1为多头注意机制得到的隐藏状态,查询矩阵、键矩阵和值矩阵具有相同的状态,Ol为嵌入层的输出。

随后的子层是位置前馈网络,由两个线性变换组成,其中使用ReLU函数进行激活。

| $ \operatorname{FFN}(\boldsymbol{X})=\boldsymbol{W}_2 \cdot \operatorname{ReLU}\left(\boldsymbol{W}_1 \cdot x+b_1\right)+b_2 $ | (16) |

| $ \boldsymbol{O}^{l+1}=\operatorname{FFN}\left(\boldsymbol{M}^{l+1}\right) $ | (17) |

式中W1、W2、O l+1为第l+1块的输出。在子层后使用残差连接和归一化。

2.3.2 空间编码器空间编码器用于提取流量数据的空间特征。空间编码器的输入数据为X, 定义为

| $ \boldsymbol{X}=(N, H, \boldsymbol{F}) $ | (18) |

式中:N为网络中的节点个数,H为历史流量数据的个数,F为网络节点的特征。

本文使用两层GCN进行空间特征提取,其可表示为

| $ f(\boldsymbol{X}, \boldsymbol{A})=\sigma\left(\hat{\boldsymbol{A}} \operatorname{ReLU}\left(\hat{\boldsymbol{A}} \boldsymbol{X} \boldsymbol{W}_0\right) \boldsymbol{W}_1\right) $ | (19) |

式中:

本文使用上述GCN模型从流量数据中学习空间特征,GCN可以提取路由与周围链路之间的拓扑关系,从而得到流量的空间依赖性。

2.4 时空特征融合层由于网络场景的复杂性,流量的时间和空间特征对未来流量的预测有不同的贡献度。所以动态调整流量的时空特征进入编码器至关重要。本文采用双边门控机制自适应动态调整这一过程。

将双路特征提取器中得到的时间特征ftemporal和空间特征fspatial输入到融合单元中。门限值c由时间特征ftemporal和空间特征fspatial决定。

| $ c=\sigma\left(\boldsymbol{W}_{\text {control }} \cdot\left[f_{\text {temporal }}, f_{\text {spatial }}\right]\right) $ | (20) |

式中:ftemporal、fspatial∈Rd×d,Wcontrol∈ Rd×2d,σ(·)是sigmoid激活函数,[]为拼接。

然后使用c引导时间特征,使用(1-c)引导空间特征。

| $ f_{\text {fusion }}=f_{\text {temporal }} \odot c+f_{\text {spatial }} \odot(1-c) $ | (21) |

式中:⊙为哈代码积,ffusion为融合之后得到的流量的时空特征。

2.5 预测解码器预测解码器基于融合后的时空特征进行流量预测。考虑到未来流量本身也是时序数据,所以本文采用基于GRU结构的解码器递归进行预测。其中GRU结构的初始值为输入流量数据的最后一个值。

3 实验在本节中通过实验验证模型的有效性。首先介绍实验数据集、模型评价指标,然后介绍实验环境和实验设置,最后是实验结果及其分析。

3.1 网络流量数据集本节评估了ST-Fusion模型在3个真实网络流量数据集中的预测性能。GEANT是面向研究和教育界的泛欧数据网络,它将整个欧洲的国家研究和教育网络(NREN)互相连接起来。其主要由23个路由器组成,具有38个链路连接。ABILENE主干网位于北美,拓扑由12个节点、30条无向链路组成。网络流量数据是从2004年3月1日至9月11日每隔5 min采样得到的。中国教育和科研计算机网(CERNET)主要连接中国国内高校,其主要包含14个路由器节点和32条链路。

3.2 评价指标为了评价ST-Fusion模型在网络流量预测任务中的性能,本文使用以下4种指标进行性能评价。

均方根误差(root mean squared error,RMSE)定义为预测值与真实值之间的开方平均平方差,反映测量极值效应和预测值的误差范围。

| $ Y_{\mathrm{rmse}}=\sqrt{\frac{1}{N} \sum\limits_{i=1}^N\left(Y_i-\hat{Y}_i\right)^2} $ | (22) |

平均绝对误差(mean absolute error,MAE)定义为平均误差绝对值,反映平均预测值的特异性。

| $ Y_{\mathrm{mae}}=\frac{1}{N} \sum\limits_{i=1}^N\left|Y_i-\hat{Y}_i\right| $ | (23) |

准确率(accuracy)代表预测的准确率,定义如下:

| $ Y_{\text {accuracy }}=1-\frac{\|Y-\hat{Y}\|_{\mathrm{F}}}{\|Y\|_{\mathrm{F}}} $ | (24) |

Explained VARiance Score为解释回归模型的方差得分,其值取值范围是[0, 1],越接近于1说明自变量越能解释因变量。

| $ Y_{\mathrm{var}}=1-\frac{\operatorname{var}(Y-\hat{Y})}{\operatorname{var}(Y)} $ | (25) |

具体而言,对于MAE、RMSE指标,数值越小代表模型效果越好。对于ACCURACY、VAR指标而言,数值越大代表模型效果越好。

3.3 实验环境和实验设置在Ubuntu16.04系统环境下,使用Pycharm集成开发环境,使用基于python3.8的Pytorch1.7进行实验。服务器配置如下:CPU为Intel Core i7-10700,GPU为Nvidia RTX 2070 SUPER。

训练模型前,需要对数据集进行预处理,将流量矩阵中的每个元素进行归一化,使流量矩阵元素的取值范围为[0, 1]。

本文将数据集的80%作为训练数据,剩余20%作为测试数据。通过采用一个滑动窗口来生成序列样本。每一组训练样本由13个时间步长组成,时间步长为5 min,其中前10个作为模型的输入,后3个作为模型的预测输出。所有的基线模型都遵循其文献中最佳参数和结果。实验中将batch size设置为32,epoch设置为300,优化器采用Adam,loss函数为MAE。

3.4 基线模型为了证明提出模型的有效性,本文选择一些基于参数类和非参数类的经典方法进行比较,其基本情况如下:

1) ARIMA, 带有卡尔曼滤波的ARIMA被广泛应用于时序建模任务中,通过拟合时序数据进行预测。

2) SVR, 采用拟合函数对时序进行回归。

3) GRU, 通过重置门和更新门来解决RNN在时序预测过程中梯度爆炸和长期依赖问题,进而提高预测模型的预测效果。

4) GCN, 通过考虑网络的拓扑结构来提高网络流量预测的准确性。

5) T-GCN(Temporal GCN), 通过融合图卷积和带有门限机制的RNN来进行网络流量预测。

3.5 训练初始化在训练过程中,本文将历史数据的部分设置为训练集ytrain、测试集ytest、和测试过程中的验证集yvalid,在训练集上采用T+T′时间滑动窗口生成时间训练序列,其中T作为输入,T′作为输出验证,使用MSE绝对平方误差作为损失函数,使用公式表示如下:

| $ \text { loss }=\sum\limits_{t=0}^{y_{\operatorname{tran}-T^{\prime}}}\left(\sum\limits_{i=1}^{T^{\prime}}\left|\hat{Y}_{t+T+i}-Y_{t+T+i}\right|\right) $ | (26) |

| $ \left(\hat{\boldsymbol{Y}}_{t+T+1}, \cdots, \hat{\boldsymbol{Y}}_{t+T+T^{\prime}}\right)=f\left(\boldsymbol{Y}_{t+1}, \cdots, \boldsymbol{Y}_{t+T}\right) $ | (27) |

式中f代表本文提出的预测模型, 它通过将MAE作为损失函数进行优化。

4 实验结果及分析表 1对比了ST-Fusion模型和其他基线模型在GEANT、ABILENE、CERNET 3个数据集中的预测性能。本文将未来15 min、30 min、60 min的3次预测结果取平均值。其中,RMSE、MAPE反映预测误差,其值越小代表预测效果越好,而ACCURACY、VAR分别体现预测精度和自变量解释因变量的方差变化的能力,其值越大代表预测效果越好。根据评价指标可得,ST-Fusion模型预测结果在所有的评价指标中取得最好成绩,既证明ST-Fusion模型较单纯时间预测或空间预测具有较好的预测能力,同时也证明其比时间、空间特征串行提取的时空预测模型T-GCN有更好的预测效果。

| 表 1 基于GEANT、ABILENE、CERNET数据集不同模型的流量预测结果 Tab. 1 Prediction results of different models on GEANT, ABILENE, and CERNET datasets |

将表 1中的预测结果按照数据集、预测时刻进行可视化,见图 2。可以看到,在15 min的流量预测任务中,ST-Fusion相较于T-GCN模型,在3个数据集中,RMSE分别减少3.14%、4.26%、8.52%。同样在30 min的预测任务中,RMSE减少约1.20%、1.69%、2.08%。同样在60 min的预测任务中,RMSE减少约1.15%、1.07%,但是在CERNET数据集上相差0.49%。这表明ST-Fusion模型较T-GCN更能够提取网络流量数据的空间特征,采用并行特征提取可以有效减少特征损失。

|

图 2 ST-Fusion模型在3个网络流量数据集MAE、RMSE、ACCURACY、VAR指标对比 Fig. 2 Comparison of MAE, RMAE, ACCURACY, and VAR indicators of ST-Fusion model on three datasets |

为了验证ST-Fusion模型是否能从网络流量数据中提取时间特征和空间特征来提高预测效果,本文将ST-Fusion模型与GRU和GCN模型进行比较。从图 2中可以看到,基于时空融合的方法比单纯时间特征预测或者空间特征预测具有更好的精度。这说明ST-Fusion模型能够很好地从网络流量数据中捕获时空特征。例如,在3个数据集15 min的预测任务中,相较于GCN模型,RMSE指标分别降低了16.25%、18.24%、44.92%,在30 min预测任务中,RMSE指标分别降低了10.53%、24.81%、29.84%,在60 min预测任务中,RMSE指标分别降低了9.22%、19.82%、17.93%,说明ST-Fusion能够很好地捕捉空间依赖性。相较于GRU模型,在15 min预测任务中,RMSE指标分别降低了15.23%、23.96%、28.81%,在30 min预测任务中,RMSE指标分别降低了7.34%、14.53%、10.26%,在60 min预测任务中,RMSE指标分别降低了1.79%、9.01%、6.05%,说明ST-Fusion能够很好地捕捉时间依赖性。

从图 2可以看出,ST-Fusion模型在3种不同拓扑下均取得最好的预测表现,说明ST-Fusion具有良好的泛化能力,可以在不同拓扑、具有不同时空特征倾向的网络流量数据预测任务中均取得不错的成绩。

图 3为ST-Fusion模型在GEANT、ABILENE、CERNET数据集下,在15 min任务中的预测结果。由图中预测曲线可知,ST-Fusion模型对网络流量数据进行预测时,其预测曲线相较于其他模型更加接近真实流量曲线,这表示ST-Fusion取得很好的预测效果。同时ST-Fusion模型在3种网络数据中均较好地拟合真实曲线,说明其针对不同的网络拓扑都具有较好的适应性结果。在一些突发的网络流量和流量波动的峰值和低谷时,ST-Fusion模型相较于T-GCN模型更加接近真实曲线,取得更小的预测误差。

|

图 3 ST-Fusion模型在GEANT、ABILENE、CERNET数据集的预测结果 Fig. 3 Prediction results of ST-Fusion model on GEANT, ABILENE, and CERNET datasets |

提出一种新的基于时空特征融合的神经网络,称为ST-Fusion。将网络拓扑抽象为非加权图。其中节点表示路由节点,边表示两个路由节点之间的网络连接,路由与其他路由的流量表示为节点的属性。模型采用编码器- 解码器结构,首先,双流编码器使用图卷积神经网络提取网络流量的空间结构,使用门限神经网络和自注意力机制相结合的方式来提取节点属性的动态变化。然后采用双边门控注意力机制进行融合最终获得时空依赖。最后使用GRU递归循环解码进行流量预测。使用ST-Fusion进行网络流量预测,在GEANT、ABILENE、CERNET 3个不同真实网络流量数据集中进行评估,同时与ARIMA、SVR、GCN、GRU、T-GCN模型进行对比,ST-Fusion在不同的评价指标中均取得更好的性能。综上所述,ST-Fusion模型能够较好地从网络流量数据中捕捉时空特征,采用ST-Fusion网络流量预测模型有利于提高SDN网络中路由调度的合理性和设备的利用率。由于提出的ST-Fusion模型本身并没有加入网络流量所独有的特征约束,所以该模型适用于数据本身具有时空两种特征的预测任务中。

| [1] |

FENG Huifang, SHU Yantai. Study on network traffic prediction techniques[C]//2005 International Conference on Wireless Communications, Networking and Mobile Computing. Wuhan: IEEE, 2005: 1041. DOI: 10.1109/WCNM.2005.1544219

|

| [2] |

LANER M, SVOBODA P, RUPP M. Parsimonious fitting of long-range dependent network traffic using ARMA models[J]. IEEECommunications Letters, 2013, 17(12): 2368. DOI:10.1109/LCOMM.2013.102613.131853 |

| [3] |

HONG W C. Traffic flow forecasting by seasonal SVR with chaotic simulated annealing algorithm[J]. Neurocomputing, 2011, 74(12/13): 2096. DOI:10.1016/j.neucom.2010.12.032 |

| [4] |

BERMOLEN P, ROSSI D. Support vector regression for link load prediction[J]. Computer Networks, 2009, 53(2): 191. DOI:10.1016/j.comnet.2008.09.018 |

| [5] |

BARABAS M, BOANEA G, RUS A B. Evaluation of network traffic prediction based on neural networks with multi-task learning and multiresolution decomposition[C]//2011 IEEE 7th International Conference on Intelligent Computer Communication and Processing. Cluj-Napoca: IEEE, 2011: 95. DOI: 10.1109/ICCP.2011.6047849

|

| [6] |

JIA Yuhan, WU Jianping, DU Yiman. Traffic speed prediction using deep learning method[C]//2016 IEEE 19th International Conference on Intelligent Transportation Systems(ITSC). Rio de Janeiro: IEEE, 2016: 1217. DOI: 10.1109/ITSC.2016.7795712

|

| [7] |

VINAYAKUMAR R, SOMAN K P, POORNACHANDRAN P. Applying deep learning approaches for network traffic prediction[C]//2017 International Conference on Advances in Computing, Communications and Informatics (ICACCI). Udupi: IEEE, 2017: 2353. DOI: 10.1109/ICACCI.2017.8126198

|

| [8] |

LAZARIS A, PRASANNA V K. An LSTM framework for modeling network traffic[C]//2019 IFIP/IEEE Symposium on Integrated Network and Service Management (IM). Arlington: IEEE, 2019: 19

|

| [9] |

RAMAKRISHNAN N, SONI T. Network traffic prediction using recurrent neural networks[C]//2018 17th IEEE International Conference on Machine Learning and Applications (ICMLA). Orlando: IEEE, 2018: 187. DOI: 10.1109/ICMLA.2018.00035

|

| [10] |

ZHOU Qinzheng, LI Qianmu, YAN Han. Long short-term memory neural network for network traffic prediction[C]//2017 12th International Conference on Intelligent Systems and Knowledge Engineering (ISKE). Nanjing: IEEE, 2017: 1. DOI: 10.1109/ISKE.2017.8258815

|

| [11] |

ZHU Yu, ZHU Junxiong, HOU Jie. A brand-level ranking system with the customized attention-GRU model[C]//Proceedings of the 27th International Joint Conference on Artificial Intelligence (IJCAI'18). [S. l. ]: AAAI, 2018: 3947

|

| [12] |

TIAN Jiyu, QIN Jing, CHEN Liming. A novel method for network traffic prediction using residual Mogrifier GRU[C]//2021 IEEE World Congress on Services (SERVICES). Chicago: IEEE, 2021: 47. DOI: 10.1109/SERVICES51467.2021.00035

|

| [13] |

CHEN Juan, XING Huanlai, YANG Hai. Network traffic prediction based on LSTM networks with genetic algorithm[C]//International Conference on Signal and Information Processing, Networking and Computers. Singapore: Springer, 2018: 411. DOI: 10.1007/978-981-13-7123-3_48

|

| [14] |

FAN Jianyong, MU Dejun, LIU Yang. Research on network traffic prediction model based on neural network[C]//2019 2nd International Conference on Information Systems and Computer Aided Education (ICISCAE). Dalian: IEEE, 2019: 554. DOI: 10.1109/ICISCAE48440.2019.221694

|

| [15] |

LU Haipeng, YANG Fan. A network traffic prediction model based on wavelet transformation and lstm network[C]//2018 IEEE 9th International Conference on Software Engineering and Service Science (ICSESS). Beijing: IEEE, 2018: 1. DOI: 10.1109/ICSESS.2018.8663884

|

| [16] |

DU Shuang, XU Zhanqi, LV Jianxin. An EMD-and GRU-based hybrid network traffic prediction model with data reconstruction[C]//2021 IEEE International Conference on Communications Workshops (ICC Workshops). Montreal: IEEE, 2021: 1. DOI: 10.1109/ICCWorkshops50388.2021.9473822

|

| [17] |

王天保, 刘昱, 郭继昌, 等. 图卷积神经网络行人轨迹预测算法[J]. 哈尔滨工业大学报, 2021, 53(2): 53. WANG Tianbao, LIU Yu, GUO Jichang, et al. Pedestrian trajectory prediction algorithm based on graph convolutional network[J]. Journal of Harbin Institute of Technology, 2021, 53(2): 53. DOI:10.11918/202006051 |

| [18] |

YANG Li, GU Xiangxiang, SHI Huaifeng. A noval satellite network traffic prediction method based on GCN-GRU[C]//2020 International Conference on Wireless Communications and Signal Processing (WCSP). Nanjing: IEEE, 2020: 718. DOI: 10.1109/WCSP49889.2020.9299774

|

| [19] |

ZHAO Ling, SONG Yujiao, ZHANG Chao. T-GCN: a temporal graph convolutional network for traffic prediction[J]. IEEE Transactions on Intelligent Transportation Systems, 2019, 21(9): 3848. DOI:10.1109/TITS.2019.2935152 |

| [20] |

GUI Yihan, WANG Danshi, GUAN Luyao. Optical network traffic prediction based on graph convolutional neural networks[C]//2020 Opto-Electronics and Communications Conference (OECC). Taipei: IEEE, 2020: 1. DOI: 10.1109/OECC48412.2020.9273638

|

| [21] |

YAO Zhenjie, XU Qian, CHEN Yongrui. Internet traffic forecasting using temporal-topological graph convolutional networks[C]//2021 International Joint Conference on Neural Networks (IJCNN). [s. l. ]: IEEE, 2021: 1. DOI: 10.1109/IJCNN52387.2021.9534096

|

| [22] |

HE Kaiwen, HUANG Yufen, CHEN Xu. Graph attention spatial-temporal network for deep learning based mobile traffic prediction[C]//2019 IEEE Global Communications Conference (GLOBECOM). Waikoloa: IEEE, 2019: 1. DOI: 10.1109/GLOBECOM38437.2019.9013136.

|

| [23] |

WU Yuankai, TAN Huanchun, QIN Lingqiao. A hybrid deep learning based traffic flow prediction method and its understanding[J]. Transportation Research Part C: Emerging Technologies, 2018, 90: 166. DOI:10.1016/j.trc.2018.03.001 |

| [24] |

CAO Xiaofeng, ZHONG Yuhua, ZHOU Yun. Interactive temporal recurrent convolution network for traffic prediction in data centers[J]. IEEE Access, 2018, 6: 5276. DOI:10.1109/ACCESS.2017.2787696 |

| [25] |

ANDREOLETTI D, TROIA S, MUSUMECI F. Network traffic prediction based on diffusion convolutional recurrent neural networks[C]//IEEE INFOCOM 2019-IEEE Conference on Computer Communications Workshops (INFOCOM WKSHPS). Paris: IEEE, 2019: 246. DOI: 10.1109/INFCOMW.2019.8845132

|

| [26] |

GUO Shengnan, LIN Youfang, FENG Ning. Attention based spatial-temporal graph convolutional networks for traffic flow forecasting[C]. Proceedings of the AAAI Conference on Artificial Intelligence, 2019, 33(1): 922. DOI: 10.1609/aaai.v33i01.3301922

|

2023, Vol. 55

2023, Vol. 55